AI视频生成框架AnimateDiff 高速运动视频依然保持稳定

10月7日 消息:众所周知,训练文生图模型的成本非常高昂。为了减轻微调模型的费用,出现了一些相应的模型定制化方法,如DreamBooth和LoRA,这使得用户可以在使用少量数据和消费级显卡的情况下提高模型的个性化和特定风格下的图像生成质量,而这是建立在开源权重的基础上的。

这一趋势推动了HuggingFace、CivitAI等开源模型社区的发展。众多的艺术家和爱好者为这些社区贡献了许多高质量的微调模型。在不知不觉中,宛如平静的海洋一下子涌起了汹涌的浪潮,海滩上留下了无数色彩斑斓的鹅卵石,这些都是爱好者们精心调制的AI画作。

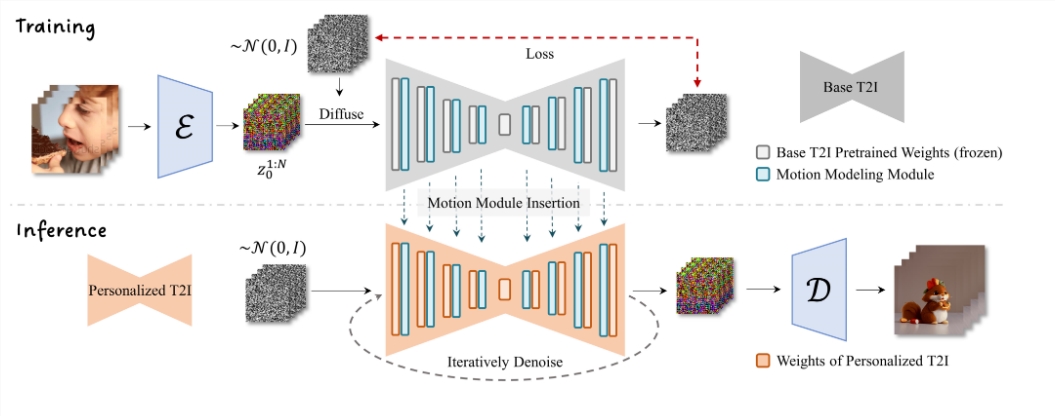

然而,与动画相比,静态图像的表现能力是有限的。最新的开源框架AnimateDiff能够将任何定制化文生图模型扩展到动画生成领域,而且在保持原有定制化模型画面质量的基础上,还能生成相应的动画片段。这使得色彩斑斓的鹅卵石增添了一些动态的光泽。

AnimateDiff 是一款强大的工具,它允许您轻松地将文本转化为动画图像,而无需特定的调整。它为用户提供了无限的创意和探索空间,让您可以将文本描述转化为令人惊叹的动画场景。

它的优势在于将真人电影视频转换成的动画,在激烈的动作下,视频依然可以异常的稳定。该项目提出了一个有效的框架,可以一次性为大多数现有的个性化文本到图像模型提供动画效果,节省了模型特定调整的工作。

项目地址:https://github.com/guoyww/animatediff/

核心功能:

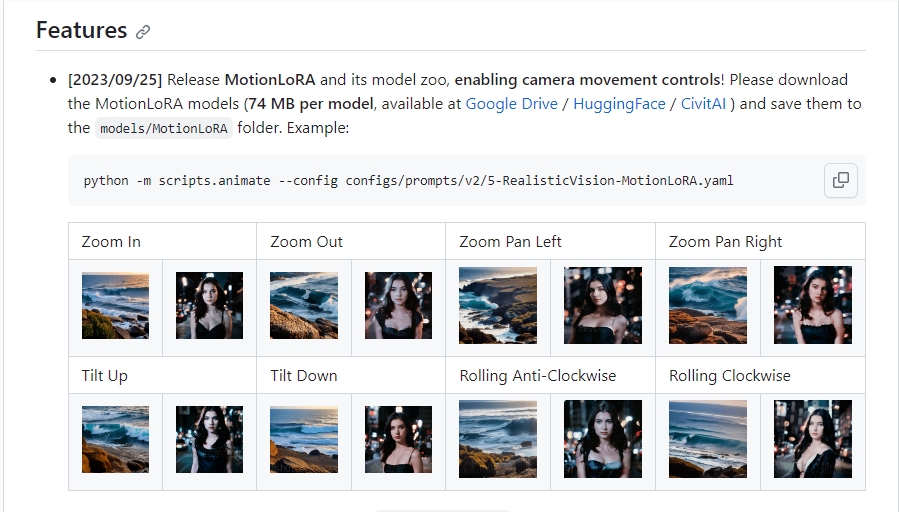

MotionLoRA 模型支持: 最新发布的 MotionLoRA 模型以及其模型库,为您提供了对相机运动的控制能力。您可以轻松地实现缩放、平移、倾斜和旋转等相机动作,从而打造生动的动画场景。

强大的 Motion 模块: 这个工具提供了多个 Motion 模块,包括 mm_sd_v14.ckpt、mm_sd_v15.ckpt 和 mm_sd_v15_v2.ckpt,它们支持高分辨率和批处理训练,提供卓越的图像质量。

简便的环境设置: 安装和配置 AnimateDiff 非常简单,只需几个命令即可轻松启动。您可以在单个 RTX3090GPU 上进行推理,而且仅需大约12GB的显存。

模型库: AnimateDiff 提供了丰富的模型库,包括 Motion 模块和 MotionLoRA 模块,以及各种可用于不同场景的模型参数。您可以根据自己的需求选择合适的模型进行推理。

Gradio 演示: 为了让用户更容易使用 AnimateDiff,该团队还开发了 Gradio 演示。只需运行几个命令,就可以在本地主机上启动演示,通过用户友好的界面进行互动。